Write something

Startframes: Der Unterschied zwischen Zufall und Art Direction

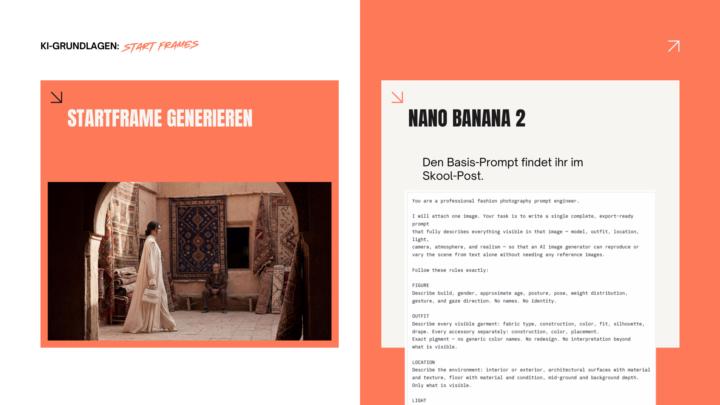

Wenn du einfach einen Text-Prompt an ein KI-Videomodell schickst, überlässt du dem Modell alle gestalterischen Entscheidungen: Aussehen der Person, Lichtsituation, Komposition, Kameraabstand, Farbpalette. Das Modell entscheidet. Nicht du. Das Ergebnis ist meistens okay. Manchmal sogar gut. Aber es ist selten das, was du dir vorgestellt hast — und du hast wenig Handhabe, es gezielt in eine bestimmte Richtung zu lenken. Startframes lösen dieses Problem. Was ist ein Startframe? Ein Startframe ist ein einzelnes Bild, das du dem Modell als ersten Frame deines Videos mitgibst. Das Modell generiert dann nicht mehr das Video von Grund auf neu — es generiert nur noch die Bewegung, die aus diesem Bild heraus entsteht. Die Konsequenz ist fundamental: Alle Entscheidungen, die du im Startframe getroffen hast, bleiben erhalten. Die Beleuchtung ist gesetzt. Die Komposition ist gesetzt. Der Look der Person oder des Produkts ist gesetzt. Das Modell hat keinen Spielraum mehr, wild zu interpretieren — es muss von deinem Bild ausgehen. Das klingt wie eine kleine technische Anpassung. In der Praxis ist es der Unterschied zwischen einem Zufallsgenerator und einem Produktionswerkzeug. Warum das für professionelle Arbeit entscheidend ist: Wenn du KI-Video für Kundenprojekte, Kampagnen oder Brand Content nutzt, brauchst du Konsistenz. Dieselbe Person soll über mehrere Shots gleich aussehen. Das Produkt soll immer dieselbe Farbe haben. Der Look soll zum Briefing passen. Mit reinem Text-to-Video ist das schwer bis unmöglich. Mit Startframes wird es machbar — weil du das Ausgangsbild kontrollierst. Wie du einen Startframe generierst: Das Modell, das wir im Workshop für Startframes nutzen, ist Nano Banana 2. Es ist spezialisiert auf die Generierung von Einzelbildern, die als konsistente Ausgangsbasis für Videomodelle funktionieren. Der Basis-Prompt dafür liegt im Skool-Post direkt darunter. Der Workflow ist einfach: Bild in Nano Banana 2 generieren → als Startframe in Krea AI (oder direkt in Kling 3.0) hochladen → Bewegungs-Prompt schreiben → generieren.

0

0

Die 5 Modelle, die 2026 zählen — und eine Plattform, die sie bündelt

Der Tool-Markt für KI-Video ist gerade gleichzeitig reifer und unübersichtlicher geworden. Reifer, weil es echte Qualitätsunterschiede gibt, über die man diskutieren kann. Unübersichtlicher, weil gefühlt jede Woche ein neues Modell lanciert wird. Hier ist, was aktuell wirklich relevant ist. **Seedance 2.0** Bytedances Stärke liegt bei Körperbewegungen — dynamische Szenen, Tanz, Sport, Menschen in Aktion. Wenn es darum geht, Bewegung glaubwürdig darzustellen, ist Seedance derzeit eine der stärksten Optionen. Einschränkung: Gesichter sind gesperrt, USA-Markt ausgeschlossen. Geopolitisch im Blick behalten. **Kling 3.0** Das aktuell vielseitigste und verlässlichste Modell auf dem Markt. Besonders stark bei Fashion Editorials und allem, was konsistente Charakterdarstellung braucht. Cineastische Kontrolle, native Audio-Generierung, Multi-Shot-Funktionalität. Kling 3.0 ist das Modell, mit dem wir im Workshop am intensivsten arbeiten — dazu mehr in den nächsten Posts. **WAN 2.6** Alibabas Open-Source-Modell. Der entscheidende Unterschied: du kannst es auf deiner eigenen Hardware lokal betreiben. Für alle, denen Datensouveränität wichtig ist oder die mit sensiblem Material arbeiten, ist das ein echter Vorteil. Die Qualität ist gut, auch wenn sie nicht ganz an Kling heranreicht. **Veo 3.1** Googles Modell überzeugt durch das beste Preis-Leistungs-Verhältnis bei Realismus. Wenn das Budget eine Rolle spielt und du trotzdem beeindruckende Ergebnisse willst, ist Veo 3.1 einen Blick wert. **Sora 2 — eine Randnotiz** War da. Ist weg. Ab 26. April offline. Für die Vollständigkeit erwähnt, aber nicht mehr relevant. **Krea AI — die Plattform, die wir empfehlen** Statt dich durch fünf verschiedene Oberflächen zu arbeiten, bündelt Krea AI die wichtigsten Modelle (darunter Kling und Veo) auf einer einzigen Website. Schnell, unkompliziert, gut für den Einstieg — und gut genug für professionelle Workflows. Mit dem Code `R9HUY8HU` erhältst du 3.000 Compute Units als Startguthaben.

0

0

Sora ist Geschichte, Seedance ist geopolitisch, und die EU macht Ernst

Drei Nachrichten, die den Markt gerade gleichzeitig umformen — und die du kennen solltest, bevor du anfängst, KI-Video ernsthaft einzusetzen. Sora ist weg OpenAI hat Sora nach gerade mal sechs Monaten eingestellt. App und Web gehen ab 26. April offline. Das Modell hat täglich rund eine Million Dollar Verlust produziert, der Disney-Deal ist geplatzt, und das Deepfake-Problem war schlicht nicht kontrollierbar. Was bedeutet das? Erstens: auch Hype hat Grenzen. Sora war das am meisten beworbene KI-Videomodell der letzten zwei Jahre — und es hat überlebt sich selbst nicht. Zweitens: es zeigt, dass ein Modell, das technisch beeindruckend ist, trotzdem scheitern kann, wenn das Geschäftsmodell fehlt und Missbrauch nicht eingedämmt werden kann. Für dich praktisch: Finger weg von Sora als Basis für irgendetwas Produktives. Das Tool existiert bald nicht mehr. Seedance 2.0 ist da — aber nicht überall ByteDance (das ist der TikTok-Konzern) hat Seedance 2.0 in über 100 Ländern gelauncht — die USA bleiben ausgeschlossen. Das ist keine technische Entscheidung, das ist Geopolitik. Seedance nutzt C2PA-Kennzeichnung, was transparenter ist als viele Konkurrenten, und Gesichter sind im Tool gesperrt. Was bedeutet das für dich? Seedance ist ein starkes Modell, besonders für Körperbewegungen und dynamische Szenen. Aber du solltest dir bewusst sein, von wem du das Tool beziehst — ByteDance-Produkte stehen in Deutschland und Europa unter zunehmend kritischer Beobachtung. Für kreative Projekte okay, für sensible Kundendaten würde ich Abstand halten. Die EU-Kennzeichnungspflicht kommt Ab 2. August 2026 müssen KI-generierte Videos in der EU sichtbar gekennzeichnet werden. Wer das ignoriert, riskiert Bußgelder von bis zu 15 Millionen Euro oder 3 Prozent des Jahresumsatzes. Das ist die Nachricht, über die die wenigsten nachdenken — bis es zu spät ist. Wie genau "sichtbar" definiert wird und wer das kontrolliert, ist noch offen. Aber die Richtung ist klar: Transparenz wird zur Pflicht, nicht zur Kür. Fang jetzt an, deine Workflows so aufzubauen, dass du sauber dokumentieren kannst, welche Inhalte KI-generiert sind. Die erste Abmahnung willst du nicht abwarten.

0

0

Von Will Smith bis Veo 3.1 — Drei Jahre KI-Video in vier Etappen

Vor drei Jahren war ein Video von Will Smith, der schlecht Spaghetti isst, das Symbol dafür, wo KI-Videogenerierung stand: experimentell, unkontrollierbar und vor allem: lustig, weil es so offensichtlich kaputt war. Heute liefern dieselben Technologien Ergebnisse, die ohne genaues Hinschauen kaum noch als KI zu erkennen sind. Was in diesen drei Jahren passiert ist, ist einer der schnellsten Entwicklungssprünge, die wir je bei einer Technologie gesehen haben — und es lohnt sich, den kurz nachzuvollziehen. Nicht als Selbstzweck, sondern weil du nur dann einordnen kannst, was die aktuellen Tools wirklich können (und was nicht), wenn du weißt, wo sie herkommen. 2023: Das Meme-Jahr Erste Experimente, kaum nutzbare Ergebnisse. Die Will-Smith-Spaghetti-Videos wurden zum kulturellen Symbol für den Stand der Technik — propmpte Unsinnigkeit, flackernde Körper, Gesichter die zerfließen. KI-Video war ein Spielzeug, kein Werkzeug. 2024: Die ersten echten Modelle Runway Gen-2 und Sora zeigten erstmals, was möglich ist: physikalisch plausible Bewegungen über mehrere Sekunden. Kling etablierte sich als starkes, günstiges Modell aus China. Zum ersten Mal wurde das Gespräch ernsthafter — nicht mehr "ob", sondern "wann". 2025: Vom Experiment zum Werkzeug Character-Konsistenz wurde möglich: dieselbe Person über mehrere Shots hinweg. Native Audio-Generierung. Multi-Shot-Sequenzen. Plötzlich konnten Produktionsprozesse, die vorher Tage oder Wochen brauchten, in Stunden abgebildet werden. Das war der Moment, wo KI-Video aufgehört hat, eine Kuriosität zu sein. 2026: Der Standard verschiebt sich Kling 3.0, Veo 3.1, Seedance 2.0 — die aktuellen Modelle liefern Ergebnisse, bei denen du zweimal hinschauen musst. Fashion Editorials, Produktvideos, Kampagnenmotive: alles, was früher ein Filmteam brauchte, lässt sich heute zumindest prototypisch in Minuten generieren. Das bedeutet nicht, dass menschliche Kreativität überflüssig wird — im Gegenteil. Aber es verschiebt, wo deine Zeit und dein Können eingesetzt werden müssen. Nicht mehr bei der Produktion, sondern bei der Direktion.

0

0

🚨 Sora schließt am 26. April 2026 – Sichere JETZT deine Daten! 🚨

Was passiert? Am **26. April 2026** wird Sora (Web & App) eingestellt. Alle nicht exportierten Inhalte werden dauerhaft gelöscht. So sicherst du deine Daten (offizielle Anleitung) 1. Gehe zu: [sora.chatgpt.com/exports/me](https://sora.chatgpt.com/exports/me) 2. Klicke auf "Export" und warte auf die Bestätigungs-E-Mail. 3. Lade die ZIP-Datei mit allen deinen Videos/Bildern herunter. 4. Manueller Download: Einzelne Dateien kannst du auch direkt aus deiner Sora-Bibliothek speichern. Deadline: 26. April 2026 – danach ist kein Export mehr garantiert! --- Unsere Empfehlung für Alternativen Falls du nach einer neuen Plattform suchst, empfehlen wir: Runway M* ([runwayml.com](https://runwayml.com)) Vorteile: - Ähnliche KI-Videogenerierung wie Sora - Europäische Server-Optionen (DSGVO-konform) - Kostenlose Testversion verfügbar --- #Datensicherung #Sora #KI #Backup

0

0

1-30 of 41

powered by

skool.com/ainother-breakfast-2203

Kaffee und Künstliche Intelligenz.

Bei AInother Breakfast dreht sich alles um KI-Themen – in entspannter Atmosphäre und mit echtem Netzwerk-Charakter.

Suggested communities

Powered by