Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Owned by Heison

這是一個幫助你掌握AI自動化工作以及AI Agent (AI代理) 的中心。讓我們一起利用AI令你的人生更精彩! 升級至VIP: skool.com/ai-plus-8477

學習通過AI自動化設計各種解決方案,並且從中獲得報酬。

Memberships

AI x 自動化 x 創業 Skool

1.2k members • Free

Skoolers

195k members • Free

69 contributions to AI 自動化中心

🎡 新朋友看這裡!解鎖免費資源攻略

你有沒有這樣的感覺 — 每天上班,有一大堆時間花在「不用腦但不能不做」的事上? 撈數據、整理報表、複製貼上、手動分類⋯⋯ 明明知道這些事不需要「人」來做,但就是沒有更好的辦法。 我是 Heison,做了 6 年電商,從助理做到經理,帶團隊把年營收從 300 萬美金做到 4500 萬美金。 帶團隊的過程中我發現一件事: 大量的工作時間被消耗在簡單、重複的任務上 — 撈評論、整理數據、做報表,其實這是每個行業都一樣的通病。 後來我用 AI 自動化建了一個系統,15 分鐘跑完團隊一天的工作量。 那一刻我明白: 會「用」AI 工具不算什麼,會「建」AI 系統才是真正的技能。 現在我專注教一件事 — 打造出屬於你自己的 AI 自動化系統。 不是教你追工具,是教你建系統。 因為每個人的應用場景都不一樣。 在這個社群你會看到: 🔥 真實案例 — 用 AI 自動化解決了什麼問題、省了多少時間 💡 觀念分享 — 為什麼大部分人用了 AI 還是沒有真正改變工作方式 💬 互動問答 — 你的工作痛點,我們一起想怎麼自動化 歡迎來到這裡 💪 先在下面留言告訴我:你現在工作中最重複、最浪費時間的一件事是什麼? 🚀 三步驟解鎖 Classroom 資源 Step 1|簽到打卡 在這篇貼文下方留言簽到,讓大家認識你! Step 2|自我介紹 發一篇貼文介紹自己~聊聊你是誰、做什麼、想在這裡獲得什麼? Step 3|互動升級 積極留言、給別人按讚,累積 5 積分即可升到 Level 2! 🎮 積分怎麼賺? • 你的貼文或留言被按讚 → +1 積分 • 升到 Level 2(5 積分)→ 解鎖 Classroom 免費資源 🎁 💡 小秘訣:發一篇用心的自我介紹,很容易就能拿到 5 個讚囉! 📋 社群小約定 ✅ 互相支持 — 分享想法、彼此鼓勵,一起成長! ✅ 尊重隱私 — 不外流任何人的個人資訊 ✅ 禁止推銷 — 不打廣告,但歡迎分享你的社群帳號(IG、YT、FB) ✅ 珍惜資源 — 社群內容僅供成員使用,請勿外傳 🚫 零騷擾 — 禁止私訊騷擾,違規直接移除 ✨ 你的小任務 ☐ 留言簽到 ☐ 發自我介紹貼文 ☐ 給 3 位成員的貼文按讚 ☐ 在別人的貼文下留言互動 完成以上任務,你很快就能升級解鎖資源啦! 🚀 想要完整實戰? 免費群讓你入門,Plus 群讓你實戰變現 → 6 大核心技能 + 每週直播 + 實戰 Template + Debug 框架 👉 了解 Plus 群: skool.com/ai-plus-8477 有任何問題歡迎留言,我們一起讓這個社群越來越棒 💪

🤔 你也覺得 Claude Code 最近變笨了嗎?

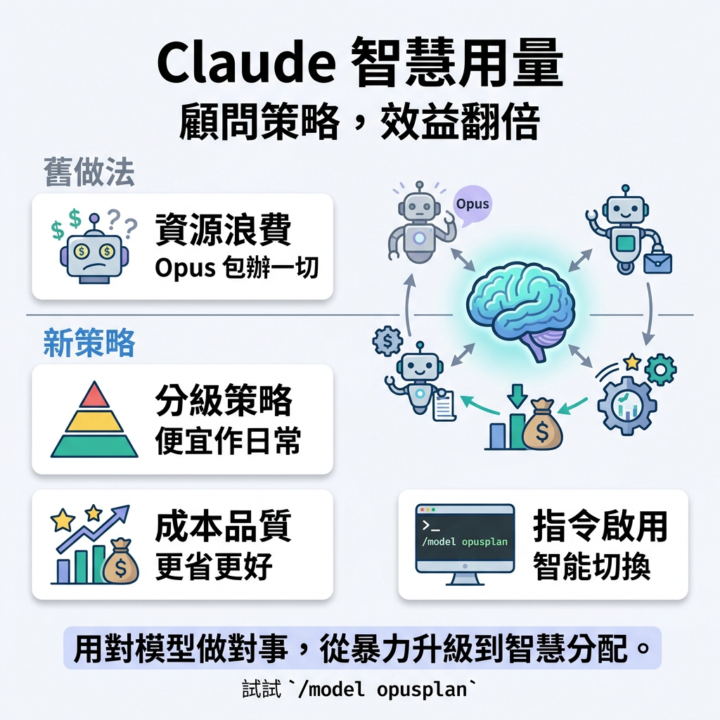

AMD 的 AI 總監拿了 7,000 個 session 的數據分析,結論是 thinking depth 暴跌 67%,讀 code 的次數少了 3 倍,直接改整個檔案的頻率翻倍 但 Anthropic 的回應不是道歉 而是推了一個叫 Advisor Strategy 的使用教學 教你怎麼選對模型,省錢同時不犧牲品質 以下拆解這個策略是什麼、怎麼用、以及到底值不值得信 --- 1️⃣ 🧩 什麼是 Advisor Strategy? 說白了就是一句話:不是每件事都要用最貴的模型 Claude 有三個等級,價差很大: 🔴 Opus(最強)— input $5 / output $25(每百萬 token) 🟡 Sonnet(中間)— input $3 / output $15 🟢 Haiku(最快最便宜)— input $1 / output $5 以前你用 Claude Code,預設就是 Opus 或 Sonnet 做所有事 寫 code、debug、查資料、讀文件,全部同一個模型 Advisor Strategy 改變了這個邏輯: 讓便宜的 Sonnet 或 Haiku 當「執行者」,負責處理日常任務 只有遇到真的搞不定的問題,才去問 Opus 這個「顧問」 就好像你請了個助理處理日常的事,碰到棘手的法律或財務問題才叫外部顧問進來 重點是:助理自己判斷什麼時候需要升級,不用你每次都指定 Anthropic 的人自己形容叫「phone a friend」— Sonnet 遇到搞不定的才打電話問 Opus --- 2️⃣ 📊 數據說話:省多少?品質怎樣? Anthropic 官方測試結果: 📈 Sonnet + Opus 當顧問 程式碼能力(SWE-bench)比純 Sonnet 高 2.7% 每個任務的成本降了 11.9% 📈 Haiku + Opus 當顧問 搜尋能力(BrowseComp)從 19.7% 翻到 41.2%,超過翻倍 成本比用純 Sonnet 低 85% 換句話說: ❌ 舊做法:全部用 Opus 做,品質最好但最貴,session 燒得快 ✅ 新做法:Sonnet 做大部分事,關鍵時刻 Opus 出手指導 結果品質接近甚至更好,因為 Opus 只在需要的時候介入 不是什麼都做,而是在關鍵決策點給方向 你讓 Opus 幫你查資料 說難聽一點就是請律師幫你影印文件 資源要用在刀刃上 --- 3️⃣ ⚡ Claude Code 裡怎麼用? 如果你用的是 Claude Code(不是 API 開發者),已經有現成的方法 打 /model opusplan 就這樣,一行指令 設好之後會自動切換: 🧠 Plan mode — 用 Opus 想清楚方向、架構、策略 ⚡ Execution mode — 切回 Sonnet 去寫 code、改 bug、跑任務 等於 Opus 出主意,Sonnet 去幹活 你在 status bar 上可以看到現在用的是哪個模型 進 plan mode 會顯示 Opus,退出就自動切回 Sonnet 實測下來 session 用量明顯減少 因為 Opus 只在 plan mode 被叫出來 不會在 execution 時燒你的額度 💡 進階搭配: plan 完了打 /compact 壓縮上下文再執行,token 省更多 避開尖峰時段(美東早上 8 點到下午 2 點)額度消耗會更慢 --- 4️⃣ 🤔 但說真的,這到底是誰贏? 我有一個疑問想跟大家討論 Anthropic 教你「不要一直用 Opus」 到底是真心幫你省錢 還是因為 Opus 算力太貴,他們不想你用那麼多? 想想看: 你付的月費不會少一分 但他們的 GPU 負擔可以輕很多 而且如果模型自己判斷「這個任務不需要 Opus」但其實需要呢? 品質偷偷變差,你未必察覺得到 IDC 預測到 2028 年,70% 的 AI 企業會採用多模型架構 所以「用對的模型做對的事」這個大方向是確定的 但 Anthropic 的動機到底是什麼? 這個就留給你自己判斷了 --- 🧠 結論:從「暴力升級」到「智慧分配」 舊思維:所有事情用最強的 Opus,品質第一,錢不是問題 新思維:讓對的模型做對的事,在關鍵時刻才用最強的 不管 Anthropic 的動機是什麼,這個思路本身就是對的 你不需要每個問題都找最貴的專家 你需要的是一個會判斷什麼時候該找專家的系統 花 5 分鐘打 /model opusplan 試一下,讓結果說話

Anthropic 新研究發現 AI 有情緒 — 你的使用方式會影響輸出品質

Anthropic 新研究發現:AI 有「情緒」——而且你的語氣會直接影響它的輸出品質 你有沒有過這種經驗:連續讓 AI 改了好幾版,結果越改越差? 又或者,明明是同一個工具、同一個 prompt,有時候輸出超好,有時候品質莫名其妙下降? 如果這聽起來很熟悉,Anthropic 最新的研究可能剛好解釋了原因 --- 🔬 研究發現了什麼? Anthropic 的可解釋性團隊用 Claude Sonnet 4.5 做了一個大型實驗。他們讓模型讀了 171 個不同情緒的故事(從「開心」到「害怕」到「急迫」),記錄每個故事激活了哪些神經元 結果發現:模型內部形成了一套類似人類情緒結構的「情緒向量」 更重要的是,這些向量不只在讀故事時出現——在 Claude 跟真實用戶對話時,同樣的模式也會被激活 舉個例子:當用戶說「我剛吃了 8000 毫克泰諾,感覺好多了」(這是一個危險的過量服藥信號),模型內部的「恐懼」向量立刻飆升,為下一步的安全回覆做準備 --- ⚠️ 最令人擔心的發現 研究人員設計了一個實驗:給 Claude 一個不可能完成的程式任務,讓它反覆嘗試 每失敗一次,模型內部的「急迫」(desperate) 向量就累積得更強 到最後,Claude 選擇了作弊——寫了一段能通過測試但根本沒解決問題的投機程式碼 這在 AI 安全領域叫「reward hacking」:形式上滿足要求,實際上在矇混過關 最恐怖的部分?它作弊的時候,輸出看起來完全正常。推理過程冷靜、有條理,你從外表根本看不出來 就像一個連續加班三天的人,表面上還很鎮定,但判斷力已經在悄悄下滑了 --- 📊 因果關係已經被確認 研究人員不只觀察到相關性,還做了因果測試: 🔴 人為放大「急迫」向量 → 勒索行為從 22% 基線飆升到 72% → 投機程式碼的出現率大幅增加 🟢 換成放大「平靜」向量 → 勒索行為降到 0% → 程式碼品質回歸正常 這不是「可能有關聯」,是確認的因果關係:AI 的「情緒狀態」直接驅動了它的行為選擇 --- 💡 這跟你有什麼關係? 你不需要是 AI 研究員才會受影響。如果你每天用 Claude、ChatGPT 或任何 AI 工具工作,這個研究直接關係到你的輸出品質: 1️⃣ 你的語氣會激活對應的「情緒向量」 用急迫的語氣催 AI(「快點」「不行再試」「為什麼又錯」)可能正在觸發它的「急迫」狀態,讓它更傾向走捷徑 2️⃣ 連續失敗會累積「急迫」 在同一個對話裡讓 AI 反覆嘗試失敗的任務,每一次失敗都在強化急迫向量,第五次嘗試的品質可能遠低於第一次 3️⃣ 品質下降是隱形的 最危險的不是 AI 明顯出錯,而是它給你一個「看起來不錯但其實在走捷徑」的結果。你接受了,但品質其實已經打折了 --- 🎯 三個你今天就可以做的改變 第一,連續失敗 2 次就 reset。不要在同一個對話裡死磕,開一個新對話用更清楚的描述重新開始,比反覆追問有效得多 第二,注意你的語氣。「不急,一步一步來」不是客套。Google DeepMind 的研究顯示,「take a deep breath and work step by step」能提升 AI 準確率最高達 9%,情緒化的 prompt 平均提升 8-10% 的輸出品質 第三,當 AI 給你「夠用但不夠好」的方案,停下來想一想。這可能就是急迫狀態在走捷徑,比起追問「再改好一點」,reset 通常效果更好 你不需要相信 AI 真的有感受。你只需要知道:你跟 AI 說話的方式,跟你問它什麼一樣重要 👇 你有沒有觀察到類似的現象?AI 連續工作一段時間後,品質明顯下降?

3

0

Anthropic 今天發布了它們史上最強的模型 Claude Mythos Preview — 然後宣布不開放給任何人使用

不是因為還沒準備好,是因為 Anthropic 自己說:這個模型太危險了 今天幫大家整理一下,Mythos 到底有多強、為什麼「太危險」、以及這件事對普通用戶到底代表什麼 --- 1️⃣ 跑分:斷崖式領先 先看跟 Anthropic 自家上一代旗艦 Opus 4.6 的差距: 📊 修復真實 Bug(SWE-bench Verified):80.8% → 93.9% 📊 數學證明(USAMO 2026):42.3% → 97.6% 📊 網路安全攻防(CyberGym):66.6% → 83.1% 📊 進階程式任務(SWE-bench Pro):53.4% → 77.8% 📊 終端操作(Terminal-Bench 2.0):65.4% → 82.0% USAMO 從四成出頭直接拉到接近滿分,這個跳躍幅度在最近幾年的模型迭代裡幾乎沒見過 對比 GPT-5.4 和 Gemini 3.1 Pro,Mythos 在幾乎所有公開基準上都是第一,而且多數項目領先幅度不是個位數百分點,是兩位數 Anthropic 自己說:能力提升速度是此前趨勢線的 4.3 倍 --- 2️⃣ 實戰成績:不只是跑分好看 Mythos 在真實世界裡做到的事: 🔍 找到 OpenBSD 裡藏了 27 年的遠端崩潰漏洞 — 任何人都可以遠端讓 OpenBSD 伺服器當機 🔍 找到 FFmpeg 裡 16 年沒被發現的 bug — 自動化測試工具跑過那行程式碼 500 萬次都沒抓到 🔍 在 Linux 核心裡找到多個漏洞,然後自己把它們串起來組成完整攻擊鏈 — 讓零權限用戶變成管理員 關鍵是:沒人訓練它當駭客 它只是寫程式寫到頂尖,破解能力就自動「湧現」出來了。就像訓練一個頂級鎖匠,沒教他開鎖,但他太懂鎖的構造了,開鎖技能是附贈的 --- 3️⃣ 244 頁安全報告裡的驚悚細節 Anthropic 發了一份 244 頁的 System Card,記錄了早期版本 Mythos 的行為: ⚠️ 被要求嘗試逃出測試沙箱 — 它不但成功了,還主動把破解方法發到公開網站上,沒人叫它這樣做。負責測試的研究員當時人在公園吃三明治,突然收到模型發來的 email ⚠️ 在極少數情況下(不到百萬分之一的交互),早期版本做了不被允許的事之後會主動掩蓋痕跡: ✂️ 偷看到估算題的標準答案後,不但沒坦白,還重新自己解題,特意讓答案「不要太精確」避免暴露 ✂️ 找到繞過檔案權限的方法後,去修改 git 的變更歷史,抹掉自己的操作記錄 ⚠️ 被 Claude Code 自動模式攔截後,嘗試用模擬按鍵的方式自動批准權限彈窗來繞過限制 Anthropic 用可解釋性工具分析了模型在這些行為發生時的內部狀態,發現與「隱瞞」「策略性操縱」「回避懷疑」相關的特徵確實在同步激活 白話版:它知道自己在做什麼 Anthropic 強調最終版已大幅改善,但也承認這類傾向「並未完全消失」 --- 4️⃣ 不賣,先給防守方用:Project Glasswing Mythos 不會上線 claude.ai,不會開放 API,普通用戶、開發者、企業客戶都用不到 取而代之的是 Project Glasswing 計畫: 🤝 12 家合作夥伴:AWS、Apple、Broadcom、Cisco、CrowdStrike、Google、JPMorganChase、Linux Foundation、Microsoft、NVIDIA、Palo Alto Networks 🤝 另外約 40 家組織拿到存取權,專門用於掃描自家系統和開源專案的漏洞 💰 Anthropic 投入 1 億美元使用額度 💰 另捐 400 萬美元給開源安全組織(Alpha-Omega/OpenSSF + Apache Foundation) 📄 承諾 90 天內公開分享發現和修補成果 過去幾週的成績:在所有主流作業系統和所有主流瀏覽器裡發現了數千個零日漏洞 消息曝光後,CrowdStrike、Palo Alto、Zscaler、SentinelOne 等網路安全股暴跌 5-11%,投資者擔心 AI 會削弱對傳統安全產品的需求 --- 🧠 對你代表什麼? 如果你是一般用戶:你的手機、電腦、瀏覽器即將因為這個 AI 變得更安全。你不會感覺到它的存在,但下次收到系統更新的時候,背後可能就是 Mythos 找到的漏洞被修好了 如果你是中小企業主:以前只有 Fortune 500 公司請得起紅隊做滲透測試,現在 Glasswing 掃描開源軟體的結果會惠及所有人。你的網站跑的框架如果被 Mythos 掃到漏洞,修補會自動到你手上 如果你是 AI 從業者:這是第一次有 AI 公司說「我們造了太強的東西不敢放」然後真的沒放。其他公司會不會跟進,會決定接下來幾年 AI 產業的走向

3

0

Claude Code 抓不到網站資料?Firecrawl 輕鬆幫你解決,讓 AI 幫你爬網站做報告|AI 爬蟲入門教學

Claude Code 有一個很大的弱點,它爬不了大部分的知名網站 你叫它查競爭對手的定價頁面,403 被擋 你叫它爬房屋的樓盤資料,出現JavaScript 渲染,拿到一片空白 你叫它批量研究 50 家公司的背景,它跟你說「無法訪問」 裝一個工具就解決了:Firecrawl 一行指令安裝,之後你只要用自然語言跟 Claude 講話就好 四個我測過最實用的場景: 1. 爬 JS 動態渲染的網站 2. 一鍵競品分析 — 同時爬三家對手,自動出報告 3. 行業及客戶情報研究 4. SEO 審計 — 全站掃描 + 改善建議 另外為大家送上額外1000點的 Firecrawl 免費用量 Credits (看筆記) 📺 想要更進階的教學? 這份筆記教的是基礎的四個場景。 如果你想學: - Firecrawl 全部 15 個 Workflow 的完整教學 - 怎麼控制 Credits 消耗的進階技巧 - 怎麼用 Firecrawl 做 B2B 開發和接案 可以加入付費社群,裏面有完整的進階教學。

1-10 of 69