Write something

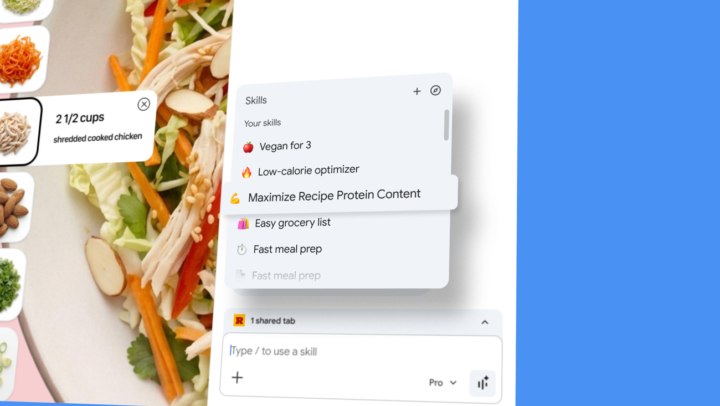

📣 AI News: Chrome zapisze Twoje polecenia do Gemini jako gotowe skróty

Jeśli często wpisujesz to samo polecenie do Gemini od nowa, Chrome pozwoli zapisać je jako gotowy skrót i odpalać jednym kliknięciem na stronie albo kilku kartach naraz. Przyda się do szybkiego streszczenia długiego tekstu, porównania ofert albo wyciągnięcia najważniejszych punktów z dokumentu. Na razie działa w Chrome na komputerze dla osób z ustawionym językiem English-US. Jakie jedno polecenie najchętniej zamieniłbyś w taki skrót? https://blog.google/products-and-platforms/products/chrome/skills-in-chrome/

2

0

Gemini + NotebookLM NOWE FUNKCJE!

Wrzuciliśmy z Norbertem nowy film o Gemini i NotebookLM 🚀 Pokazujemy, jakie nowe funkcje nadchodzą i co to może zmienić w codziennej pracy z AI. https://www.youtube.com/watch?v=5NkIQ67TdcU Jak Wy byście to wykorzystali u siebie?

1

0

📣 AI News: Microsoft testuje agenty, które same pilnują maila i kalendarza

Microsoft testuje w Copilocie agenty, które mają działać w tle i same wyłapywać rzeczy z maila oraz kalendarza. Jeśli to dowiozą, sporo codziennej roboty typu pilnowanie zadań, przypomnienia i domykanie tematów może po prostu zniknąć z ręki. Dla ludzi, którzy pracują na Microsoft 365, to może być jeden z pierwszych naprawdę praktycznych kroków od rozmowy z AI do realnej automatyzacji pracy. https://www.theverge.com/tech/911080/microsoft-ai-openclaw-365-businesses

1

0

Claude w firmie: kto używa, ile kosztuje i co wolno agentowi

Anthropic dorzuca do Claude porządek dla firm: widać, kto używa narzędzia, można ustawić limity dla zespołów i przyciąć to, co agent zrobi przez połączone aplikacje. Dla małej firmy albo agencji to ważniejsze niż kolejny mądrzejszy model, bo bez tego AI szybko robi się bałaganem i kosztem bez kontroli. Jeśli używacie Claude w pracy, to właśnie takie rzeczy decydują, czy wejdzie do codziennej pracy na serio. Wpuścilibyście to do zespołu już teraz? Źródło: https://claude.com/blog/cowork-for-enterprise

1

0

Gemini pokaże Ci wykres albo model zamiast samego opisu

Google dorzuciło do aplikacji Gemini interaktywne modele i symulacje, więc zamiast czytać suchy opis możesz od razu zobaczyć jak coś działa i poklikać parametrami. To przydatne, gdy uczysz się czegoś nowego, tłumaczysz temat klientowi albo chcesz szybciej ogarnąć trudniejszy fragment bez skakania po kilku stronach. Ja widzę tu prosty use case do nauki, prezentacji i wyjaśniania bardziej złożonych rzeczy w pracy. https://blog.google/innovation-and-ai/products/gemini-app/3d-models-charts/

2

0

1-30 of 178

skool.com/startujai

Pokazujemy jak zrozumieć i praktycznie wykorzystać sztuczną inteligencję w życiu, pracy i biznesie.

Powered by