Activity

Mon

Wed

Fri

Sun

May

Jun

Jul

Aug

Sep

Oct

Nov

Dec

Jan

Feb

Mar

Apr

What is this?

Less

More

Owned by Lina

Transición del Duelo, Adiestramiento, Adopción. Sientes que le fallas a tu Pet-Mascota?Veterinaria con 27 años. Nunca estarás sol@ 🌎🐾💙

Memberships

Leadership Skool

1.4k members • Free

Learn Any Language

371 members • Free

The Directory On Skool

468 members • Free

SKOOL PARTNERS ⭐️🚀

1.4k members • Free

Skool Add-ons

944 members • Free

Expertos invisibles 🚀

42 members • Free

Pinterest Skool

3.8k members • Free

GREAT Community Leaders

449 members • Free

El Barquito Skool

99 members • Free

40 contributions to Master en Avatares con IA 🤖

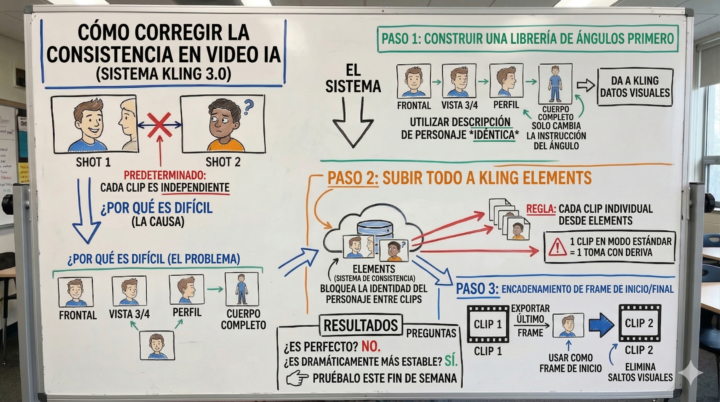

Cómo solucionar la consistencia en vídeo IA (Sistema Kling 3.0)

El problema de que tu avatar parezca una persona distinta en cada clip no es un error de la herramienta, es cómo funcionan por defecto. Cada clip se genera de forma independiente. Sin un anclaje, el modelo empieza de cero cada vez. Este es el sistema de tres pasos para fijar la identidad de tu avatar: PASO 1 — Crear una librería de ángulos primero Antes de animar nada, genera varias vistas del mismo personaje: frente, tres cuartos, perfil y cuerpo completo. La clave aquí es mantener la descripción del personaje idéntica en todas las generaciones. Solo cambia la instrucción del ángulo. Esto le da a Kling los datos visuales necesarios para entender quién es tu avatar. PASO 2 — Cargar todo en Kling Elements Elements es el sistema de consistencia integrado en Kling 3.0. Su función es bloquear la identidad del personaje en cada clip que generes. Hay una regla obligatoria: genera cada clip desde la sección de Elements. Si generas un solo clip en modo estándar, ese plano tendrá drift (variaciones de rostro) y romperá la secuencia. PASO 3 — Encadenamiento de frames (Start/End Frame) Para tomas consecutivas, exporta el último frame del clip 1 y úsalo como el frame de inicio (Start Frame) del clip 2. Esto elimina los saltos visuales entre cortes y hace que el movimiento sea fluido. ¿Es un sistema perfecto? No siempre. Pero es mil veces más estable que trabajar sin él. Nota: El sistema de la pizarra (Elements) es el flujo de trabajo nativo de Kling. Se puede replicar esta misma lógica de consistencia dentro de Higgsfield, aprovechando que ahora integra el motor de Kling 3.0, lo haremos dándole una buena imagen fija de referencia y mediante un Prompt de Personaje invariable, el motor de Kling 3.0 se encarga del resto para que la identidad no se pierda entre tomas. Prueba este sistema y deja tus resultados en los comentarios.👇

Flujo de Trabajo : Ingeniería Inversa de Vídeos Virales con IA

Quiero compartir un sistema que utilizo para deconstruir contenido. Cuando identifico un Reel o TikTok con un rendimiento excepcional, en lugar de intentar adivinar cómo se hizo, aplico ingeniería inversa. Paso 1: Análisis y Extracción Descarga el vídeo objetivo y súbelo a Gemini. Su capacidad para procesar los datos visuales y el audio de forma simultánea es muy alta. Identificará el guion, separará las escenas, detectará los ángulos de cámara y analizará el ritmo general. Paso 2: El Prompt de Deconstrucción Esta es la estructura exacta que utilizo para obtener el esqueleto del vídeo. Puedes copiarla directamente: Rol: Eres un especialista en análisis de vídeo e ingeniería inversa con IA. Tu objetivo es deconstruir el vídeo adjunto en un desglose técnico detallado para entender su estructura y producción. Tarea: Realiza un análisis plano a plano. Debes extraer y organizar la siguiente información: - Marcas de tiempo: Segundo de inicio y fin para cada cambio de plano o ángulo. - Cinematografía: Tipo de plano (ej. primer plano, plano medio) y movimiento de cámara (estática, seguimiento, zoom). - Sujeto y Entorno: Descripción exhaustiva de la persona (apariencia, vestuario, actitud) y los elementos del fondo (iluminación, decoración). - Objetos: Lista de elementos clave visibles (modelos de teléfono, mobiliario, etc.). - Guion: Transcripción exacta del diálogo sincronizada con las marcas de tiempo. - Análisis IA (Opcional): Si el vídeo parece generado por IA, señala indicadores técnicos como texturas de piel, precisión de la sincronización labial o errores de iluminación. Formato de salida: Presenta el desglose en una tabla Markdown limpia, seguida de un breve resumen del "Gancho Visual" y la "Configuración Técnica". Tono: Analítico, preciso y profesional. Paso 3: Integración y Reconstrucción Una vez tienes el esqueleto, puedes escalar el proceso. Dentro de esa misma conversación, educa al modelo sobre tus propias herramientas. Proporciónale contexto sobre:

🎥 La estrategia detrás del nuevo vídeo: Gancho potente

Compañer@s, acabo de subir un nuevo Reel a Instagram y quería compartirlo por aquí para desgranar un poco la estrategia que hay detrás del vídeo. Os dejo el enlace al Reel en Instagram. https://www.instagram.com/reel/DWwrEf9jM8T/?igsh=MzV2YTBlM3dzdG1n El Hook: Detener el scroll En este vídeo he querido llevar al extremo el hook inicial. Como veréis, los primeros 3 segundos muestran una chica cayendo a través del techo. El objetivo es puramente visual: crear una interrupción brusca. Si no conseguimos que el usuario frene en seco su scroll, da igual lo bueno que sea el guion o el producto que ofrezcamos después, porque nadie llegará a verlo. La herramienta para el realismo: Aprovecho porque varios me habéis escrito preguntando cómo conseguir que los avatares tengan aspecto cinematográfico y mantengan la cara tan estable en planos distintos. La herramienta clave para esto es Higgsfield. He conseguido un enlace para nosotros con un 65% de descuento en el Plan Anual. ⚠️ Transparencia ante todo: Este descuento se aplica si cogéis el plan Anual. Si vais en serio con la monetización y la creación de contenido a medio.largo plazo , es una buena inversión, porque a la larga os ahorráis una pasta frente a pagar mes a mes, y estan todos los recursos en un mismo lugar. 👉 https://higgsfield.ai?ref=anniversary_gTJn69HjNv4 ¡Mil gracias a todos y a seguir creando! 👇

Diferencia lipsync Nativo vs Español

He generado este video de venta con tres avatares en inglés, porque quería probar la fluidez máxima del lipsync nativo y la microexpresión facial. El nivel de realismo que se alcanza cuando el modelo procesa en su idioma base es significativamente mejor, le he puesto subtítulos en español. ¿Notáis la diferencia en la naturalidad de la boca comparado con los renders en español?

Workflow paso a paso vídeo de los 3 Personajes: (Respuesta a Pablo y Lina )

Chic@s, a raíz de la pregunta que me hicisteis en el post del vídeo en inglés sobre cómo lo hice con los 3 personajes os he creado este post. Podeis guardar este sistema exacto para conseguir consistencia. Las 2 herramientas clave: Nano Banana 2: Para la generación de imágenes (nuestros fotogramas clave). Kling 3.0: Para la animación y el vídeo. (Opcional: Topaz o similar para el Upscale final). Aquí tenéis el paso a paso: Paso 1: La Preparación (El 80% del éxito) Antes de tocar Nano Banana 2, lo primero es buscar una imagen de referencia potente (yo suelo tirar de Pinterest). La iluminación y el realismo de esa imagen base lo son todo. A partir de ahí, creo mi propio prompt con chatgpt o gemini. Importante: Tenéis que usar la misma imagen de referencia en el prompt para todas las variaciones. Es la única forma de clavarle los candados visuales a la IA para que mantenga la consistencia a rajatabla. Paso 2: Generar los Fotogramas Clave (Ángulos y Poses) El objetivo aquí es usar Nano Banana 2 para generar 5 imágenes consistentes, pero diferentes entre sí. No queremos 5 fotos idénticas. Manteniendo siempre la imagen de referencia como candado, vamos a cambiar el texto del prompt para pedirle a la IA distintos planos (un primer plano, un plano medio, desde la izquierda, desde la derecha...). Estas 5 fotos con distintos ángulos van a ser nuestros puntos de anclaje. Si el Paso 1 está bien hecho, los 3 personajes se verán iguales en todas las fotos, solo cambiará la perspectiva. Paso 3: La Animación y Transiciones (Kling 3.0) Nos llevamos esas 5 imágenes con diferentes ángulos a Kling 3.0. Para crear transiciones impecables como movimientos de cámara usaremos la función de Start Frame + End Frame (Fotograma Inicial + Fotograma Final). Le das a Kling la imagen 1 (ej: plano medio) como inicio y la imagen 2 (ej: primer plano) como final. La IA se encarga de rellenar el movimiento de cámara intermedio conectando ambos ángulos sin que las caras se derritan. Repites el proceso encadenando las 5 fotos.

1-10 of 40

⭐

🔥

@lina-santos-3870

Médica Veterinaria 🩺 Odontología ·Adiestramiento ·Duelo de Mascotas ·Cirugía ·Anestesióloga | 27 años 🇨🇴 + 🇺🇸 | PetPals Pets-Mascotas 🌎🐾💙

Active 2h ago

Joined Jan 7, 2026